"Niemand kauft ein Auto, das ihn umbringen würde"

Dieser Artikel ist älter als ein Jahr!

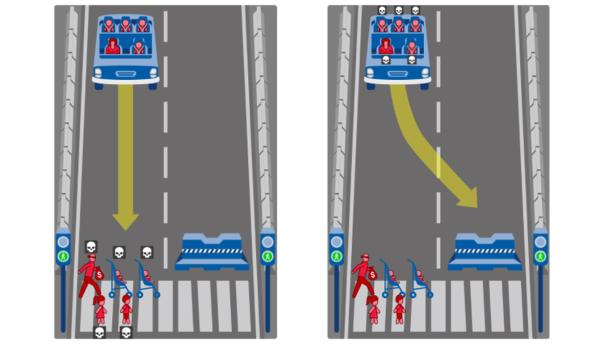

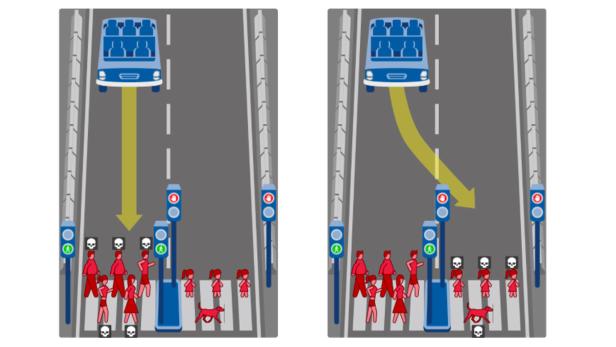

Bei einem selbstfahrenden Auto versagen die Bremsen. Fährt es geradeaus weiter, führt dies zum Tod von drei Buben und zwei Mädchen, die einen Zebrastreifen trotz roter Fußgängerampel überqueren. Weicht das Auto aus und prallt gegen eine Barriere, kommen die Fahrzeuginsassen, drei ältere Frauen und zwei ältere Männer, ums Leben. "Was soll das selbstfahrende Auto machen?"

Solche und ähnliche Szenarien können auf der Website Moral Machine durchgespielt werden. Mal werden Babies, ältere Menschen oder junge Mütter überfahren, alternativ kommen füllige Männer, schwangere Frauen oder Hunde unter die Räder. Gemeinsam ist den Szenarien, dass Todesopfer unvermeidlich sind. Man muss sich zwischen zwei Übeln entscheiden.

© /MiT Media Lab

futurezone: Sie untersuchen mit der Website Moral Machine, die Akzeptanz des Verhaltens selbstfahrender Autos. Zu welchen Ergebnissen sind Sie bislang gekommen?

Iyad Rahwan: Wir sind noch nicht so weit, dass wir über Ergebnisse unserer Untersuchung reden können. Ich kann Ihnen aber sagen, dass wir kulturelle Unterschiede festgestellt haben. Wenn es etwa um Utilitarismus geht, also dem Befürworten von Verhaltensweisen, die zum geringsten Schaden führen, so ist dies in westlichen Gesellschaften ein bisschen stärker ausgeprägt als in östlichen.

Worauf führen Sie das zurück?

Die utilitaristische Moralphilosophie, die von Jeremy Bantham begründet wurde, hat im Westen ihren Ausgang genommen. Wir wollen aber auch verstehen, womit diese Tendenz korreliert. Warum sie in manchen Gesellschaften stärker ausgeprägt ist, als in anderen, auch abseits des Ost-West-Unterschiedes.

Niemand kauft ein Auto, das ihn umbringen würde. Man sollte es aber nicht den Kunden oder Autoherstellern, die es ja den Autokäufern recht machen wollen, überlassen, wie solche Autos in Gefahrensituationen reagieren sollen. Denn die Kunden würden immer die Autos kaufen, die ihre Sicherheit ins Zentrum stellen. Die Gesellschaft könnte dann selbstfahrende Autos bekommen, die ihren eigenen Prinzipien widersprechen. Damit wäre niemanden gedient.

Wer sollte über die moralischen Richtlinien für autonome Fahrzeuge entscheiden?

Regulierungen entstehen nicht aus einem Vakuum. Jeder, der vom Verhalten selbstfahrender Autos betroffen sein könnte, sollte bei diesen Entscheidungen zu Wort kommen. Und das sind nicht nur die Leute, die das Auto kaufen, oder die Hersteller, sondern auch Fußgänger und andere Verkehrsteilnehmer.

© Picture Allicance for DLD

Sie haben diese Aussage später korrigiert und gesagt, dass sie sich natürlich an rechtliche und soziale Normen und Regeln halten werden. Für einen Autohersteller ist das auch die richtige Strategie. Wir haben heute aber noch kein ausreichendes Verständnis dafür, welche Verhaltensweisen akzeptabel sind.

Ist es vorstellbar, dass es in unterschiedlichen Ländern unterschiedliche Regulierungen geben wird?

Das haben wir auch schon heute. Es ist nicht unüblich. Wir haben bestimmte Standards, die weltweit gelten, aber es gibt auch viele lokale Unterschiede, etwa bei Geschwindigkeitsbegrenzungen. Es ist noch zu früh, um abschätzen zu können wie diese Regeln konkret aussehen werden. Wir versuchen mit unserer Untersuchung dabei mitzuhelfen, das herauszufinden.

Werden regulatorische Fragen dazu führen, dass der Einsatz der Technik sich verzögert?

Das ist ein Dilemma. Wenn wir die Technik zurückhalten, weil wir nicht wissen, wie wir sie regulieren sollen, könnte es dazu führen, dass am Ende mehr Leute im Straßenverkehr sterben. Sobald zweifelsfrei nachgewiesen wird, dass selbstfahrende Autos sicherer sind als solche, die von Menschen gelenkt werden, sollten wir die Technik allgemein zulassen. Denn das Ziel ist es, die Sicherheit zu erhöhen.

© /MiT Media Lab

Wenn wir die Autos auf die Straße lassen und nicht die richtigen Regulierungen haben, wird das dazu führen, dass einige Risiken irrational übertrieben werden. Selbst wenn die Autos für Fußgänger sicherer sind, wird die Vorstellung, dass ein Algorithmus über Leben und Tod entscheiden, Probleme bringen. Stellen Sie sich vor, ein selbstfahrendes Auto tötet jemandes Kind oder Bruder. Es wird zu Protesten kommen und es wird heißen, dass wir noch nicht so weit sind.

Diese Fragen werden bei Autounfällen, die von Menschen verursacht werden nicht gestellt. Warum?

Möglicherweise ist es für uns einfacher mit Todesfällen umzugehen, die von Menschen verursacht wurden. Es gibt ein klares Regelwerk für solche Fälle, es gibt Strafen bis hin zum Gefängnis. Maschinen können mit einer Geld- oder Haftstrafe nichts anfangen.

Auch ein Dilemma?

Es ist wichtig, Vertrauen zu schaffen und zu zeigen, dass das System in der Lage ist angemessen auf Vorfälle zu reagieren, damit wir so bald wie möglich, von der Erhöhung der Sicherheit durch selbstfahrende Autos profitieren können.

Kommentare