Supercomputer machen auch Superschweinereien

Dieser Artikel ist älter als ein Jahr!

1983 gründeten der junge Computerwissenschaftler Daniel Hillis und die Architektin Sheryl Handler die Firma „Thinking Machine“. Hillis träumte davon, eine Maschine zu bauen, die denken kann und stolz auf ihre Erbauer ist. Seine Doktorarbeit befaßte sich mit Parallelverarbeitung. In der „Connection Machine“ (CM), die von Thinking Machine gebaut wurde, waren bis zu 65.536 Prozessoren gleichzeitig am Werk.

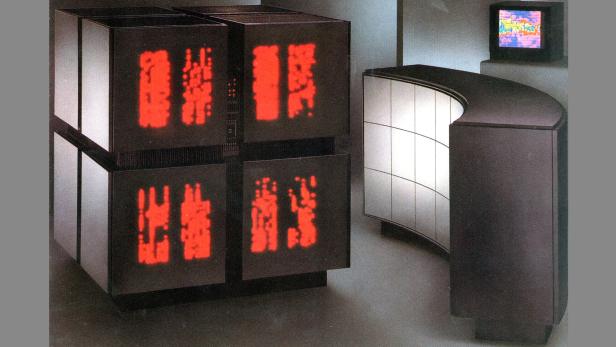

Und endlich sahen Computer auch in der Wirklichkeit so aus, wie sie im Kino schon lange aussahen: Die CM bestand aus düster-eleganten Kuben in einer Farbe, die firmenintern „Darth-Vader-Black“ genannt wurde, übersät mit roten Leuchtdioden. Jede Diode zeigte die Aktivität eines der Prozessoren in der Maschine an. Steven Spielberg fand die Technologie so toll, dass er als Supercomputer in seinem Film Jurassic Park eine Connection Machine vorsah, obwohl es sich in dem zugrundeliegenden Roman von Michael Crichton um einen Cray-Supercomputer handelt.

Als aber mit dem Ende des Kalten Kriegs Anfang der Neunzigerjahre die Subventionen des US-Verteidigungsministeriums ausblieben und Firmen wie IBM und Intel in den Supercomputer-Markt vorstießen, wurde es eng. 1994 musste Thinking Machines Konkurs anmelden. Insgesamt waren 112 Connection Machines verkauft worden.

Hillis hatte sich im übrigen weitsichtig zur Zukunft des Computerns geäussert. So stellte er sich eine künftige Version der Maschine als öffentliche Intelligenz-Ressource vor, die der Welt den Zugang zu (künstlicher) Intelligenz ermöglichen sollte, so wie man Wasser und Strom bezieht. Es sei technisch machbar, eine tausendmal größere Maschine zu bauen als die Connection Machine. Eine solche Maschine wäre groß wie ein Haus geworden, aber die ersten Computer in den fünfziger Jahren hatten auch ganze Etagen eingenommen.

Das eigentliche Problem aber waren - und sind - die Probleme. Die meisten computergerecht formulierbaren Probleme sind angesichts der Leistungsfähigkeit einer solchen Maschine trivial. Es muß also einen neuen Beruf geben: den Problemdesigner. Den Experten, der computergerechte Probleme maßschneidern kann. Der die algorithmisierbaren Teile der Realität erkennt und in Programme umsetzt, und der das Nichtalgorithmisierbare, das Wilde an der Welt, minimiert, interpoliert und unbedeutend macht.

Rechengroßgeräte

Der Begriff lässt kaum Raum für Zweifel: Supercomputer machen grosse Dinge. Im März 2002 etwa ging in Yokohama der Earth Simulator in Betrieb. Für die Maschine wurde ein 3.250 Quadratmeter grosses Gebäude errichtet, die halbe Fläche eines Fußballfelds. Bis zum Juni 2004 hielt das Großgerät den Spitzenplatz als schnellster Rechner der Welt. In dieser Zeit diente es der Erforschung des Klimawandels und möglicher Lösungen für globale Umweltprobleme. Große Sache.

Derzeit hält der aus 3,12 Millionen Prozessorkernen bestehende Computercluster Tianhe-2 („Milchstrasse-2“) des National Supercomputer Center im chinesischen Guangzhou die Führungsposition.

Die großen Herausforderungen

Anfang der Neunzigerjahre hatte Allan Bromley, Wissenschaftsberater des damaligen US-Präsidenten Bush, unter dem Titel „Grand Challenges“ eine Liste mit Problemen vorgestellt, zu deren Lösung ein Vielfaches der bereitstehenden Computerleistung benötigt würde und einen Etat in Höhe von drei Milliarden Dollar beantragt. Auf der Liste standen Fragen wie die, weshalb das Universum so aussieht, wie es aussieht. Große Sache.

Um die Jahrtausendwende gab es eine erste Annäherung an eine Antwort: die Millennium-Simulation zeigte erstmals, wie aus kleinen „Störungen“ nach dem Urknall grosse Unregelmässigkeiten entstehen, wie wir sie aus dem heutigen Universum kennen. 2010 zeigt die auf dem Plejades-Supercomputer des Ames Research Center der NASA durchgeführte Bolshoi-Simulation die bislang akkuratesten Ergebnisse dieser Computernachbildung der Entstehung von überhaupt allem.

Das eigentlich Erstaunliche ist: Man staunt nicht. Naja, eine Urknallsimulation. Es ist die Mischung aus Dummheit und Geschwindigkeit, die uns an Computern beeindruckt.

Der Plejades-Supercomputer der NASA, auf der die Bolshoi-Simulation gerechnet wurde, gehört übrigens zur Altix-Familie von Hochleistungsrechnern der Firma Silicon Graphics. Werden Systeme der Altix-Familie mit einem Grafikmodul ausgestattet, heißen sie „Prism“.

Totale Überwachung

Das namensgleiche NSA-Überwachungsprogramm PRISM hat seinen Anfang im Jahr 2005 genommen, also genau zwischen den beiden Supercomputer-Simulationen des Universums. Mit PRISM wird die digitale Kommunikation umfassend überwacht. Enthüllt wurde dieses Programm, das zum Synonym geheimdienstlicher Methoden im Internet-Zeitalter wurde, von Edward Snowden.

Hier nun sind die Problemdesigner an der Arbeit – im Utah Data Center beispielsweise, das die NSA seit 2013 nahe einer Stadt mit dem schönen Name Bluffdale betreibt. Das Gelände mit dem wurstförmigen Umriss, auf dem der wahrscheinlich größte und leistungsfähigste Supercomputer-Rechnerpark der Welt betrieben wird, umfaßt 93.000 Quadratmeter, es hätten also 28 Earth-Simulatoren darauf Platz.

Zwischen 1,4 Megabyte und 140 Terabyte pro Person

Die Leistungsfähigkeit der Anlage lässt sich nur schätzen. Umgerechnet auf die Weltbevölkerung soll ihre Speicherkapazität einem Datenvolumen von zwischen 1,4 Megabyte und 140 Terabyte pro Person entsprechen. „Damit“, merkt die Wikipedia lapidar an, „wird der Schritt in die komplette Überwachung und Speicherung der weltweiten Kommunikation möglich.“

„Kultur ist Reichtum an Problemen“, schrieb der österreichische Schriftsteller und Historiker Egon Friedell schon vor 100 Jahren, „und wir finden ein Zeitalter um so aufgeklärter, je mehr Rätsel es entdeckt hat.“ Womit er hellsichtig bereits die Arbeitsgrundlage der Code- und Verfassungsknacker des 21. Jahrhunderts im Blick hatte.

Kommentare