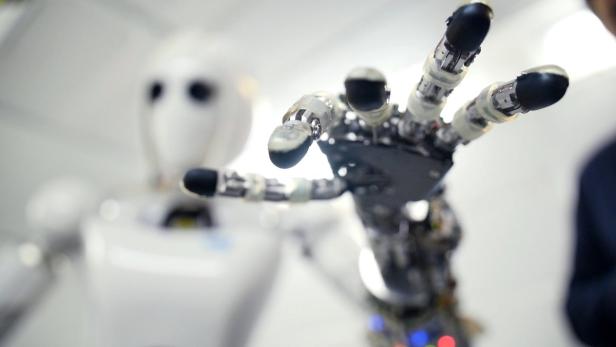

Singularität: Die Angst vor der klugen Maschine

Dieser Artikel ist älter als ein Jahr!

Übermenschliche Wesen, die unsere Geschicke lenken, sind seit Erfindung der Religion ein fixer Bestandteil menschlicher Kultur. Mit dem technischen Fortschritt mussten bärtige Alleswisser, die über den Wolken wohnen, zeitgemäßeren Superwesen weichen. Mary Shellys Frankenstein ist ein frühes Beispiel für die Übertragung dieses Minderwertigkeitskomplexes auf die Früchte wissenschaftlicher Bestrebungen.

Die Idee, dass ein von Menschen geschaffenes Wesen seine Schöpfer übertreffen könnte, hat seither nichts von ihrer Faszination verloren. Vor allem in der Science-Fiction ist das Konzept allgegenwärtig. Ob die Supermaschinen gefürchtet werden müssen oder wir ihnen zu Dankbarkeit verpflichtet sind, schwankt dort von Fall zu Fall. Das Spektrum reicht von rachsüchtigen, bis an die Zähne bewaffneten Cyborgs in Terminator über ambivalente Roboter in Isaac Asimovs Werk bis zu den benevolenten Philosophenmaschinen, die in den Büchern von Iain Banks über eine anarchistisch-utopische Gesellschaft der Zukunft wachen. Mit dem Aufstieg der Computertechnologie ist die Hassliebe für denkende Maschinen auch in die Realität übergeschwappt.

Singularität

Die atemberaubende Geschwindigkeit, mit der die verfügbare Rechenleistung in den vergangenen Jahrzehnten gewachsen ist, hat der Idee der intelligenten Maschine neue Triebkraft verschafft. In den 80er-Jahren haben sich Informatiker bemüht, etwas zu erschaffen, was üblicherweise als “künstliche Intelligenz“ bezeichnet wird. Sie sind gescheitert. „Vielleicht war es ein Fehler, das Wort ’künstliche Intelligenz’ für derartige Systeme zu verwenden. John McCarthy, der den Terminus ’Artificial Intelligence’ geprägt hat, wollte das als Überschrift für einen Vortrag für eine Konferenz und der Begriff hat sich dann gehalten“, sagte Robert Trappl, Leiter des Austrian Research Institute for Artificial Intelligence in einem Interview mit der futurezone.

Durch diese frühen Fehlschläge fristete das Forschungebiet lange Zeit ein Nischendasein. Unter anderem Namen wurde das Konzept der superintelligenten Maschine, die entweder all unsere Probleme lösen soll oder unsere Existenz bedroht, von den Technologie-Utopisten aus dem Silicon Valley wiederbelebt: Zur Jahrtausendwende sprachen plötzlich alle von der „technologischen Singularität“. Gemeint war jener Zeitpunkt, an dem die Menschen eine Maschine bauen, die intelligenter ist als sie selbst. Ab diesem Moment würden sich die künstlichen Intelligenzen nach Ansicht der Utopisten selbst verbessern, wodurch ihre Intelligenz exponentiell anwachsen würde.

Silicon Prophets

Bekannt gemacht wurde die Idee von der Singularität vor allem vom US-Autor, Erfinder und Zukunftsforscher Ray Kurzweil, der derzeit als „Director of Engineering“ im Sold von Google steht. Er bezeichnete die Singularität als einen Wandel, der „so schnell und allumfassend ist, dass er einen Bruch in der Struktur der Geschichte der Menschheit darstellt.“ Seither hat die Idee weiter an Fahrt aufgenommen. Die Entwicklung von selbstfahrenden Autos, Maschinen, die Menschen in Go oder Jeopardy schlagen, sowie das Aufkommen sprachgesteuerter Assistenzsoftware haben die Erwartung an die Intelligenz der Maschinen weiter vergrößert.

Kurzweil, der dem Konzept der Singularität viel Geld verdient hat, und andere Silicon-Valley-Propheten, die der Meinung sind, dass Technologie (aus ihren Häusern) alle Probleme der Menschheit lösen wird, haben durch geschicktes Marketing ihr übriges getan, um das Konzept weiter in der öffentlichen Diskussion zu verankern. “Der Hype existiert, weil es langsam möglich wird, Systeme zu bauen, die eine gewisse Intelligenz an den Tag legen, etwa bei selbstfahrenden Autos. Firmen wie Google und Apple nutzen und befördern diesen Hype. In Wirklichkeit gibt es noch viele offene Fragen“, sagte der KI-Experte Roland Siegwart von der ETH in Zürich im futurezone-Interview.

Auch in der Literatur und in Form von Film und Serie ist die Idee derzeit wieder populär, siehe Westworld, Ex Machina oder Her. Die faktische Basis bleibt allerdings sehr dünn. Intelligente Maschinen gibt es nicht, zumindest nicht in dem Sinn, in dem wir Intelligenz bei Menschen definieren. Und das wird auch eine Weile so bleiben. “Schachspielen gilt als Zeichen von Intelligenz, trotzdem würde niemand einem Schachcomputer menschliche Intelligenz zusprechen. Wir haben heute zwar sehr spezifische Systeme, die in gewissen Situationen schneller und besser reagieren als der Mensch. Aber Intelligenz umfasst auch Kreativität und andere Eigenschaften. Ich glaube nicht, dass Maschinen, wie wir sie heute auf Siliziumbasis bauen, das können“, sagte Siegwart.

Dumme Maschinen

Selbst relativ einfache, klar abgesteckte Vorgänge wie das Autofahren beherrschen Maschinen heute nur unter kontrollierten Umständen. “Wenn Sie eines von Googles selbstfahrenden Autos in den Berufsverkehr in Indien schicken, werden Sie sehr schnell sehen, was solchen Systemen noch fehlt“, sagte Siegwart. Trotz solcher Unzulänglichkeiten werden heute unzählige Systeme als „smart“ angepriesen. Intelligent sind solche Systeme aber nicht, wie jeder Nutzer, der sich schon einmal mit einer Haussteuerungsanlage herumgeschlagen hat schnell merkt. Solche Lösungen nutzen zwar den Input von vielen Sensoren, um selbstständig Entscheidungen zu treffen, denken tun sie dabei aber nicht. Auch die persönliche Assistenzsoftware, die den nächsten Schritt in der Weiterentwicklung der Schnittstelle zwischen Mensch und Maschine darstellen soll, wirkt nicht sonderlich intelligent. Eine Konversation mit Apples Version, genannt Siri, entzaubert den Mythos der intelligenten, sprachgesteuerten Maschine schnell. Jedes fünfjährige Kind ist ein überzeugenderer Gesprächspartner.

Komplett ausschließen lässt sich die Entstehung intelligenter Maschinen aber nicht. Das erklärt auch, warum namhafte Forscher und Unternehmer, darunter Elon Musk und Stephen Hawking, 2015 einen offenen Brief publiziert haben, in dem sie zur Vorsicht bei der Erforschung von künstlicher Intelligenz mahnen. “Es kann sein, dass wir wie in der Physik auf eine grundlegende Unschärferelation stoßen, die genaue Aussagen über das System unmöglich macht, aber es sieht derzeit so aus, dass synthetische Systeme alles können werden, was der Mensch kann - und mehr“, sagte Robert Trappl im Interview. Ob Intelligenz nur eine Funktion von komplexer Verschaltung ist, ist letztlich noch nicht geklärt. Wissenschaftler können heute nicht abschließend sagen, wie Bewusstsein, Denken und andere kognitive Prozesse im Gehirn entstehen. „Ob eine KI je wirklich Intelligenz zeigen kann, ist eine philosophische Frage. Es ist schwer zu definieren, was Intelligenz überhaupt ist“, sagte Siegwart.

Die bisherigen Serienteile:

Teil 1: Der Mensch von morgen: Perfekt, unsterblich - zu allem bereit?

Essay von Helmut Brandstätter: Die Wissenschaft wird uns gottähnlich machen - oder zerstören

Teil 2: Der Genetiker Markus Hengstschläger über die Thesen von Yuval Harari

Teil 3: Wie der Mensch den Schwangerschaftscode knacken will

Teil 4: Über die Gefahren der Mensch-Optimierung

Teil 5: Zukunft der Menschheit: Droht das Ende der Demokratie?

Kommentare