Google-Mutter warnt Mitarbeiter vor Chatbot Bard

Dieser Artikel ist älter als ein Jahr!

Die Google-Mutter Alphabet hat ihre Mitarbeiter*innen vor der Nutzung Chatbots wie den hauseigenen Bard oder ChatGPT von OpenAI gewarnt. Das Unternehmen wies seine Angestellten an, keine vertraulichen Informationen in Bard oder ChatGPT einzugeben, bestätigten 4 mit der Situation vertraute Personen gegenüber der Nachrichtenagentur Reuters.

Alphabet ist offenbar besorgt darüber, das menschliche Prüfer*innen, die die generative künstliche Intelligenz unterstützen, die Informationen zu Gesicht bekommen könnten. Risiken, das sensible Informationen auf diese Weise den Weg aus dem Unternehmen finden könnten, sieht Alphabet auch darin, dass die eingegeben Daten zum Training der KI genutzt werden.

➤ Mehr lesen: "Wir werden von künstlicher Intelligenz enttäuscht sein"

Seine Ingenieur*innen warnte Alphabet laut dem Bericht auch davor, Code zu verwenden, der von den generativer künstlicher Intelligenz wie Bard oder ChatGPT generiert wurde oder eigenen Code in die Systeme einzugeben.

Auch andere Unternehmen besorgt

Alphabet bestätigte gegenüber Reuters die Anweisung. Die Google-Mutter ist auch nicht das einzige Unternehmen, dass seine Mitarbeiter*innen zur Vorsicht im Umgang mit generativer KI aufruft. Samsung hat seinen Angestellten die Nutzung von ChatGPT sogar untersagt, nachdem im April internet Informationen und Code über den Chatbot an die Öffentlichkeit geraten waren. Vorbehalte gegen die Nutzung generativer künstlicher Intelligenz im Unternehmen gibt es etwa auch bei Amazon und Apple.

➤ Mehr lesen: Samsung verbietet seinen Angestellten, ChatGPT zu nutzen

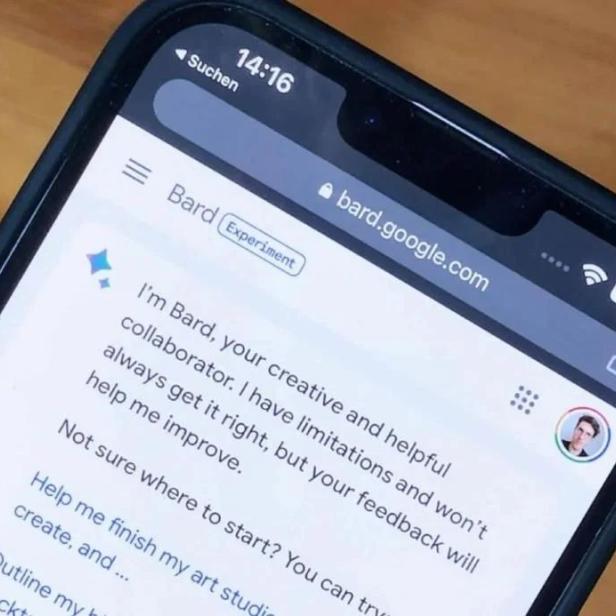

Google hatte Bard im März öffentlich zugänglich gemacht, nachdem der Druck auf das Unternehmen durch die Zusammenarbeit von Microsoft mit dem ChatGPT-Entwickler OpenAI gestiegen war. In der EU ist der Chatbot auf Basis des Google-Sprachmodells LaMDA (Language Model for Dialogue Applications) aber noch nicht zugänglich.

Kommentare