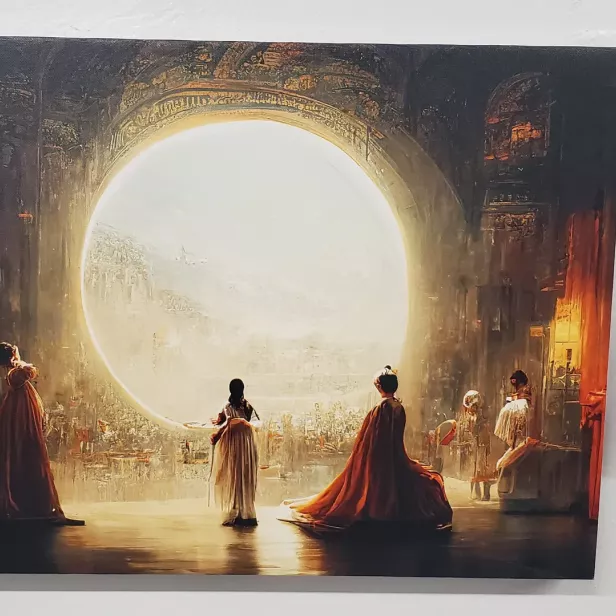

Eines der Bilder der gruseligen, KI-generierten Frau Loab

Rätselhafte, gruselige Frau taucht immer wieder in KI-Bildern auf

Dieser Artikel ist älter als ein Jahr!

Um Bildgeneratoren wie DALL-E oder Midjourney gab es in den vergangenen Monaten viel Aufsehen. Die Programme erstellen per künstlicher Intelligenz Bilder aus der Eingabe von Wörtern, die das Potenzial haben, die Kunstwelt auf den Kopf zu stellen. Nun ist dabei ein rätselhaftes Gesicht aufgetaucht, das bei einer bestimmten Art von Eingabe immer wieder erscheint.

Das Gegenteil eines Begriffs

Wie Vice berichtet, wurde der Figur bereits ein Name gegeben. "Loab" nennt sich das Gesicht einer alptraumhaft erscheinenden Frau. Ihr Antlitz tauchte erstmals bei Sucheingaben mit sogenannten "negative promt weights" auf. Dabei befiehlt man einem Bildgenerator, das Gegenteil eines bestimmten Begriffs bildlich darzustellen. Offenbar erscheint Loab bei einer Vielzahl solcher negativer Begriffe.

Das Digitalkunst-Twitter-Profil Supercomposite, das Loab auf die Spur gekommen ist, beschreibt das Phänomen folgendermaßen: "Ihre Gestalt wurde aus einer Reihe von Eigenschaften gemacht, die alle das Gegenteil von etwas sind. Aber ihre kombinierten Eigenschaften sind dennoch ein zusammenhängendes Konzept für die KI, und fast alle davon ausgehenden Bilder enthalten eine wiedererkennbare Loab."

Nicht nachvollziehbarer Horror

Besonders gruselig wird das ohnehin schon abschreckende Gesicht von Loab, wenn das Bild mit bestimmten anderen Bildern kombiniert wird. Hier ein Beispiel: Achtung, grauslich! Die Resultate scheinen nun noch mehr einem Horrorstreifen zu entstammen. "Durch eine Art auftauchenden statistischen Fehler hängt etwas an dieser Frau mit extrem blutrünstigen und makaberen Bildern zusammen", meint Supercomposite.

Eine genaue Beantwortung der Frage, wie Loab entsteht, ist unmöglich. Der genaue Ablauf, wie Bildgeneratoren zu einem bestimmten Bildresultat gelangen, ist in einer Art "Black Box" verborgen. Der Weg kann nicht nachvollzogen werden. Genau aus diesem Grund warnen Skeptiker*innen auch davor. Die Ergebnisse von selbst lernenden Textinterpretationsprogrammen seien zu unberechenbar und potenziell schädlich.

Kommentare