Nachlese: Google-Präsentation auf der I/O im Liveticker

Dieser Artikel ist älter als ein Jahr!

Am Dienstag startet mit der Google I/O die wichtigste Konferenz des Suchmaschinenkonzerns. Traditionell werden dort neue Produkte und Dienste vorgestellt, die das kommende Jahr laut Google prägen werden. Auch gibt die Konferenz Einblicke in Googles künftige Pläne und Strategien.

Für heuer werden unter anderem ein neues, günstiges Pixel-Phone sowie Informationen zum neuen Android Q erwartet. Vorab sind bereits einige Details durchgesickert.

Die Keynote startet um 19:00 mitteleuropäischer Zeit. Wir sind vor Ort und tickern live:

Liveticker: Google I/O 2019

-

Einlass

Die Tore des Shoreline Amphitheaters in Mountain View sind offen, die ersten der Tausenden Besucher strömen auf das Gelände, um rechtzeitig bei der Keynote bereit zu sein. Um 19:00 MESZ geht es los!

-

Hier lest ihr, was vorab erwartet wird:

-

Livestream

Hier findet ihr übrigens den Livestream:

-

Einlass zur Hauptbühne! Noch ist es relativ leer

-

Kleines Quiz, bevor es losgeht

Wisst ihr die Antwort?

-

Es wird laut

Der DJ spielt mit KI-Unterstützung. Und es klingt wie Musik!

-

Der AI-DJ aus Japan ist fertig, in ein paar Minuten gehts dann wirklich los...

-

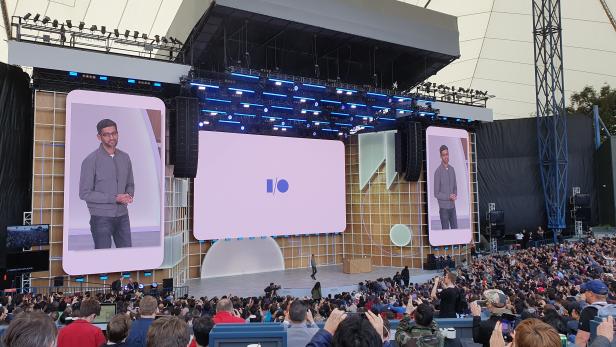

Los gehts: Google-Chef Sundar Pichai ist auf der Bühne!

Er wird sich bemühen, die Keynote zu beenden, bevor Liverpool gegen Barcelona beginnt.

-

Begrüßung und Ziele

Google-Produkte sollen laut Pichai hilfreich sein, „in großen und kleinen Momenten des Lebens“. Er erklärt, wie Google etwa hilft, E-Mails schneller zu schreiben und Wege besser zu finden. Im Fokus sollen Vertrauen und Privatsphäre stehen.

Neues wird es unter anderem bei den Suchergebnissen im Bezug auf Nachrichten geben. So sollen künftig etwa Timelines angezeigt werden, um den Verlauf von Berichterstattung besser nachvollziehen zu können. Auch Podcasts sollen direkt geliefert werden.

-

Augmented Reality und Google Lens

Jetzt ist Aparna Chennapragada auf der Bühne. Sie ist bei Google unter anderem für Augmented Reality und Google Lens zuständig.

Die Kamera soll künftig besser in die Suche integriert werden. Dank Augmented Reality können 3D-Modelle direkt in die Umgebung eingeblendet werden. Wenn Studenten etwa ein Modell der Muskeln des menschlichen Armes suchen, können sie es direkt vor sich virtuell erscheinen lassen.

Google Lens im Lokal

Neues gibt es auch bei Google Lens. Wenn man künftig etwa die Speisekarte eines Restaurants durch Lens ansieht, werden automatisch die beliebten Gerichte angezeigt.

Wenn man die Kamera auf die Rechnung richtet, wird automatisch ausgerechnet, wie viel Trinkgeld man geben soll. Auch kann man so die Rechnung direkt wie gewünscht aufteilen.

-

Duplex for Web

Pichai ist wieder da: Er spricht über Google Duplex. Zur Erinnerung: Dabei handelt es sich um das Tool, das automatisch in Geschäften anruft, um Dinge für einen zu erledigen. So kann es etwa Frisörtermine vereinbaren, oder Tische reservieren.

Duplex, das bereits in den USA im Rahmen einer Testphase verfügbar ist, wird nun ausgeweitet. Es wird künftig auch für Automieten und Kinokarten verwendet werden können.

In der Praxis soll das so funktionieren: Man bekommt eine Erinnerung über eine bevorstehende Reise. Man kann dem Assistant dann einfach auftragen, ein Auto für den Trip zu buchen. Duplex besucht dann die Webseite des Autovermietdienstes, füllt das entsprechende Formular automatisch aus und wartet nur noch auf die Bestätigung des User. Google nennt den Dienst „Duplex for Web“.

-

Next Generation Assistant

Nun ist Google-Assistant-Chef Scott Huffman auf der Bühne. Er spricht darüber, wie man den Sprachassistenten künftig verbessert. So soll er nicht mehr über die Cloud, sondern direkt auf den Geräten ausgeführt werden könne. Das soll eine deutlich schnellere Sprachsteuerung ermöglichen. Google nennt das Projekt „Next Generation Assistant“.

-

Huffman spricht von einem „Paradigmenwechsel“. Wenn der Assistant direkt am Smartphone ausgeführt wird, funktioniert er auch offline. Der neue Assistant soll noch heuer auf die „neuen Pixel-Phones“ kommen.

Er erklärt auch, wie der Assistant künftig deutlich besser den Kontext von Befehlen erkennen wird.

-

Der Google Assistant bekommt außerdem einen „Driving Mode“. Jenen kann man einfach per Sprachbefehl starten, sobald man in ein Auto steigt. Verfügbar ist es ohne zusätzliche App auf allen Handys mit Assistant. Dabei handelt es sich offenbar um eine reduzierte Alternative zu Android Auto.

-

Über dem Open-Air-Gelände fliegt übrigens ein Google-kritisches Flugzeug. Auf dem Banner steht: "Google Control is not Privacy".

-

Inkognito-Modus für Maps

Pichai ist wieder auf der Bühne. Er spricht nun über Privatsphäre und Sicherheit. Google habe in den letzten Jahren viel in diesem Bereich getan. Ein neues Feature, das demnächst kommt, ist ein Inkognito-Modus für Maps. Das Funktionsprinzip ist das gleiche wie im Browser. Man kann Maps nutzen und Orte suchen, ohne, dass ein Verlauf oder irgendwelche anderen Informationen gespeichert bleiben.

Ab sofort ist außerdem die vor einigen Wochen verkündete Funktion, mit der man sein Android-Handy zu einem Zweifaktor-Gerät machen kann.

-

Nun spielt Google ein Video ab, das zeigt, wie Spracherkennung auch für Menschen ermöglicht werden soll, die nicht wie die Mehrheit der Menschheit sprechen. Dazu zählen Personen, deren Sprache etwa durch Krankheiten wie Schlaganfälle beeinflusst wurde. Google arbeitet an einem Machine-Learning-Projekt, das Spracherkennung auch für diese Menschen ermöglicht.

-

Android 10

Nun geht es um Android, Stephanie Cuthbertson ist auf der Bühne. Laut Google verzeichnet man erstmals über 2,5 Milliarden aktive Android-Geräte. Zuerst geht es um faltbare Handys, außerdem spricht sie 5G an, das vom neuen Android nativ unterstützt wird.

-

Das neue Android unterstützt Live Caption. Dabei können bei jedem Video Untertitel generiert werden. Das funktioniert völlig ohne Internetverbindung und wird lokal am Gerät berechnet.

Cuthbertson kündigt außerdem offiziell den systemweiten Dark Mode an, der mit Android Q integriert wird.

Ein weiterer wichtiger Punkt wird Privatsphäre sein. Das neue Android soll User künftig besser Informieren, wenn Apps den Standort abfragen. Außerdem verspricht Cuthbertson zeitnähere Updates für Funktionen, die relevant für Privatsphäre und Sicherheit sind.

-

Focus Mode

Das neue Android soll auch helfen, Ablenkungen auszuschalten. Ermöglichen soll das ein „Focus Mode“. Dabei werden Benachrichtigungen bis auf wenige Ausnahmen deaktiviert. So kann man etwa festlegen, dass einen nur bestimmte Kontakte erreichen und bestimmte Apps stören dürfen.

Android-P- und Q-Handys werden den Focus Mode ab Herbst nutzen können.

-

Nest Hub Max

Der Nest Hub Max ist offiziell! Dabei handelt es sich um ein neues Smart Display mit integrierter Kamera und integriertem Mikrofon, das gleichzeitig das eigene Heim überwachen soll.

Wer die Kamera nicht verwenden will, kann sie übrigens standmäßig physisch abdecken.

Sein kleiner Vorgänger wird übrigens demnächst in mehr Märkten verkauft, unter anderem in Deutschland. Das heißt, dass man ihn wohl auch in Österreich einfacher kaufen können wird.

-

Das günstige Pixel 3a ist da

Die Gerüchte waren also wahr, ein günstiges Pixel ist da! Und es hat einen Kopfhöreranschluss!

-

Es geht wieder um KI

Das Pixel wurde sehr schnell abgehandelt, nun geht es (wieder) um künstliche Intelligenz. Zuerst erklärte Google, wie die Bedeutung von Wörtern besser erkannt werden sollen. Dabei registriert das System auch, welche Wörter davor und danach kommen, um den Kontext besser registrieren zu können.

Außerdem angesprochen wird, wie künstliche Intelligenz bei der Diagnose von Krankheiten wie Krebs eingesetzt werden kann. Im Rahmen eines Testlaufs konnte ein System so trainiert werden, dass ein bösartiger Tumor deutlich schneller und genauer als von menschlichen Ärzten diagnostiziert werden konnte.

-

Over and out

Die Keynote ist vorbei!

Die I/O und unsere Berichterstattung gehen aber weiter. Auch in den kommenden Tagen werden wir über die zahlreichen Sessions und Neuerungen des Suchmaschinenkonzerns berichten!

Vorerst aber vielen Dank für die Aufmerksamkeit!

Kommentare