Besteht ein Zusammenhang zwischen Körpertemperatur und Depression? Die Wissenschaft sagt: ja.

Klebrige Tentakel im Gesicht helfen Robotern, Emotionen zu lesen

Dieser Artikel ist älter als ein Jahr!

Künstliche Intelligenz kann menschliches Verhalten manchmal sehr gut interpretieren. Bei der Erkennung und richtigen Einordnung von Emotionen gibt es aber manchmal Schwierigkeiten. Für Roboter, die Umgang mit Menschen haben, ist es aber wichtig, Emotionen korrekt zu interpretieren und sich an seelische Zustände anzupassen. Forscher*innen aus Südkorea haben ein Gerät entwickelt, das dabei helfen soll.

Transparente Tentakel im Gesicht

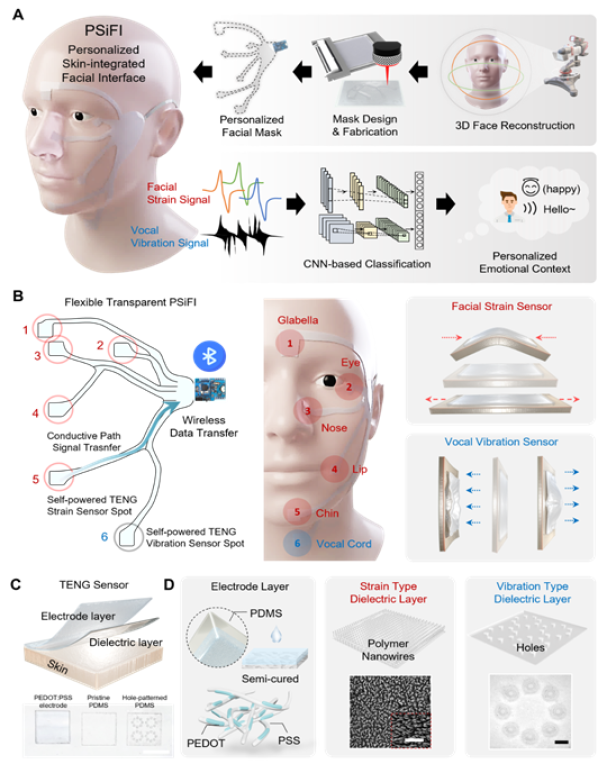

An der Universität UNIST in Ulsan wurde ein Aufkleber kreiert, der sich mit mehreren tentakelartigen Fühlern über das Gesicht von Menschen erstreckt. Wie New Atlas berichtet, besteht das Teil aus mehreren dünnen, flexiblen Sensoren, die auf der Stirn, neben dem Auge, an der Nase, nahe den Lippen, am Kinn und am Hals anliegen. Am Hals werden die Vibrationen der Stimmbänder beim Sprechen erfasst. Ein kleiner Chip, der zwischen Auge und Ohren geklebt wird, ist der Zentralteil, der Daten drahtlos per Bluetooth weiterleitet.

➤ Mehr lesen: Gestresste Anfragen an ChatGPT bringen bessere Resultate

Der Sticker erfasst die Bewegungen der Trägerin bzw. des Trägers und erkennt so die Mimik der Person. Durch das Dehnen und Zusammenziehen der elastischen "Tentakel" wird auf piezoelektrischem Weg Strom erzeugt, der das Gerät antreibt. Laut den UNIST-Forscher*innen stellt ihr System, das sie PSiFI nennen (für Personalized Skin-integrated Facial Interface), das erste tragbare, völlig eigenständige Emotionserkennungsgerät dar.

Aufbau des PSiFI Emotionssensors am Gesicht, entwickelt von UNIST in Südkorea

© UNIST

Anwender*innenkreis wahrscheinlich klein

Wer PSiFI tragen soll, erschließt sich nicht auf den ersten Blick. Das Gerät könnte zu Forschungs- oder Trainingszwecken eingesetzt werden, um die Emotionserkennung durch Künstliche Intelligenz zu verbessern. Außerdem zum Einsatz kommen könnte es für VR-Nutzer*innen, damit etwa ihr Avatar in der virtuellen Welt die Emotionen in einen entsprechenden Gesichtsausdruck umwandelt.

"Mit diesem System ist es möglich, Emotionserkennung in Echtzeit mit nur wenigen Lernschritten und ohne komplexe Messgeräte zu implementieren", sagt Jin Pyo Lee, Erstautor der Studie zu PSiFI, die im Fachmagazin Nature Communications veröffentlicht wurde. "Das eröffnet Möglichkeiten für tragbare Emotionserkennungsgeräte und emotionsbasierte digitale Dienste der nächsten Generation."

Kommentare