Wenn Drohnen mit eigenen Augen fliegen

Dieser Artikel ist älter als ein Jahr!

Sie schmuggeln Handys und Drogen in Gefängnisse, stürzen auf das Weiße Haus ab und sollen in naher Zukunft für Amazon und andere Zusteller Pakete ausliefern. Die Rede ist von fliegenden Minidrohnen, die derzeit auf der ganzen Welt Schlagzeilen machen. Eine Schwachstelle haben die unbemannten Flugroboter aber fast alle: Sie müssen von Menschen gelenkt werden, welche die Technik in vielen Situationen noch nicht ausreichend im Griff haben. Aufgrund der Instabilität vieler Systeme genügt oftmals der kleinste Fehler, um solche Drohnen zum Absturz zu bringen.

Kamera als Auge

An der Robotics and Perception Group der Universität Zürich versucht man das Problem mittels Kameratechnologie zu lösen. Um autonom fliegen und agieren zu können, benutzen die Flugobjekte ein auf den Boden ausgerichtetes Kameraauge. Dieses scannt die Umgebung der Drohne nach markanten Bodenpunkten, die auf einem Minicomputer direkt an Bord des Quadrocopters analysiert und verarbeitet werden. Weitere Sensoren, wie ein Beschleunigungssensor und Gyroskope helfen, die Punkte in Relation zu setzen und die Drohne mit ihren vier Rotoren zu stabilisieren.

Anstatt sich auf die menschliche Steuerung oder auch GPS verlassen zu müssen, das in geschlossenen Räumen oder in der Stadt schnell an Grenzen stößt, kann die Drohne sich selbstständig orientieren und autonom Aufgaben erfüllen. Ziel der Entwicklung ist der Einsatz derartiger Drohnen in Rettungs- und Kriseneinsätzen, um sich in einem unbekannten Gebiet zurechtzufinden oder etwa in einem halb eingestürzten Gebäude nach Opfern zu suchen. „Der Vorteil liegt auf der Hand: Das System ist völlig unabhängig von externer Infrastruktur. Auch menschliche Fehlleistungen, die gerade in einer Krisen- und Stresssituation bei der Steuerung auftreten können, sind so vermeidbar“, erklärt Elias Müggler, der das Forschungsprojekt als Doktorand an der Universität Zürich mitbetreut.

Amazon vs Rettungseinsatz

Auch wenn die prinzipiell bestehende Funkverbindung zu den Einsatzkräften abreiße, könne die Drohne weiterhin ihre Arbeit verrichten und im Ernstfall Leben retten, sagt Müggler im Gespräch mit der futurezone. Derartige Drohnen könnten zukünftig auch verwendet werden, um Medikamente schnell zu liefern oder Rettungsbojen abzuwerfen, wenn Menschen zu ertrinken drohen. In einem adaptierten Anwendungsszenario können die Flugobjekte auch ein 3D-Modell der Umgebung erstellen. Dies funktioniert derzeit allerdings nur in Kombination mit einer Verbindung zu einem leistungsstarken Rechner am Boden.

Daran, dass Amazon künftig Tausende Drohnen losschicken wird, um Bücher und CDs anzuliefern, glaubt Müggler eher nicht. „Technisch ist das natürlich möglich. Ich bin aber skeptisch, dass ein derartiger Flugverkehr gesellschaftlich akzeptiert wird“, sagt Müggler.

"Fliegendes Smartphone"

In der derzeitigen Forschung, die in eindrucksvollen Videos dokumentiert ist, setzt das Team der Uni Zürich auf im Handel erhältliche Standardkomponenten. Das Quadrocopter-Gerüst stammt von Parrot, als Mini-Computer fungiert ein Odroid-System, die restlichen Sensoren und die Kamera sind mit gängigen Smartphone-Komponenten vergleichbar. Um alles passgenau zusammenbauen zu können, kommt ein 3D-Drucker zum Einsatz, der die Verbindungsstücke produziert. „Man könnte durchaus von einem fliegenden Smartphone reden. Die gesamte Software ist Open-Source-basiert, damit wir bei jedem Schritt verstehen, was genau passiert“, erklärt Müggler.

Als größte Herausforderungen für das kamerabasierte autonome Fliegen sehen die Forscher schwierige Lichtverhältnisse, aber auch die Bewegungsunschärfe der Kamera bei schnellen Manövern. Je höher die Auflösung und die Frame-Rate, desto genauer können Flugmanöver von der Drohne durchgeführt werden. Aber auch mit speziellen Hochgeschwindigkeitskameras stößt man schnell an Grenzen des On-Bord-Systems, da für die Verarbeitung und Speicherung der enormen Datenmengen hohe Ressourcen und somit auch wieder Energie sowie entsprechendes Gewicht notwendig sind.

Retina-ähnliche Kamera

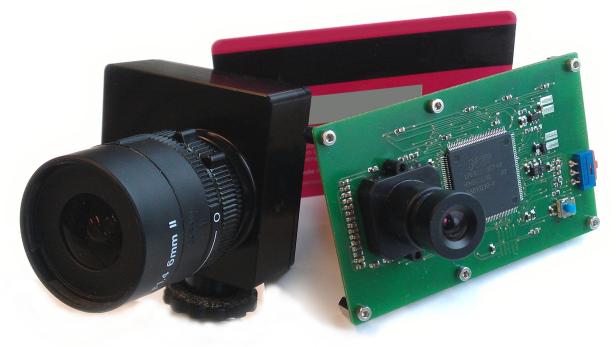

Das Problem, dass herkömmliche Kameras immer komplette Bilder schießen, auch wenn sich an den aufgenommenen Pixel nichts ändert, könnte mit neuer Kameratechnologie gelöst werden. Am Institut für Neuroinformatik der Universität Zürich wurde ein dem menschlichen Auge ähnlicher Sensor entwickelt, der nur Pixel-Veränderungen erkennt. Dadurch können die redundanten Datenmengen, die viel Speicher, RAM, Prozesserleistung und Energie fressen, minimiert werden.

© IniLabs

Neue Algorithmen

„Die Forschung der Kollegen hinsichtlich Retina-ähnlicher Fotosensoren ist vielversprechend und kann einige Probleme der Bildverarbeitung von Flugdrohnen lösen“, sagt auch Müggler. Die große Herausforderung bestehe nun allerdings darin, alle Algorithmen so anzupassen, dass sie auch mit der neuen Technologie funktionieren. „Da diese Kameras nach einem völlig anderen Prinzip funktionieren, muss man bei der Verarbeitung und Übersetzung der Daten für den Flugroboter ebenfalls neue Wege gehen“, meint Müggler im futurezone-Gespräch.

Kommentare