Software macht Deepfake-Video aus nur einem Foto

Dieser Artikel ist älter als ein Jahr!

Täuschend echte, aber dennoch gefakte Videos, die mithilfe einer künstlichen Intelligenz erstellt wurden, haben der jüngsten Vergangenheit für Aufsehen gesorgt. Bei den so genannten Deepfake-Videos orientiert sich eine Software an vorhandenem Bildmaterial und kann daraus die abgebildete Person beispielsweise gewünschte Sätze sagen lassen.

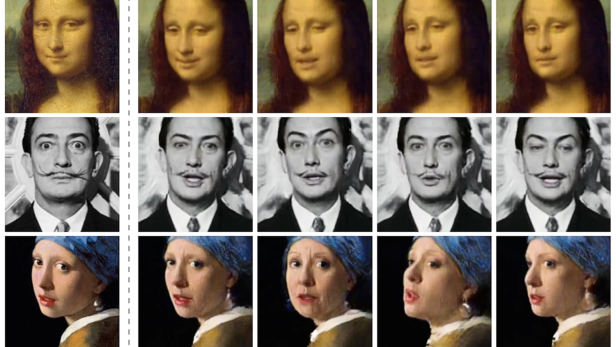

Bisher waren die Ersteller von Deepfake-Videos auf mehrere Portrait-Fotos oder gar Bewegtbild angewiesen, um die KI entsprechend zu trainieren. Nun ist es Forschern des Samsung AI Center gelungen, aus nur einem einzigen Bild ein entsprechendes Fake-Video zu erstellen.

Die Wissenschafter haben dafür auf weithin bekannte Portraits von berühmten Persönlichkeiten zurückgegriffen. Auf diese Weise konnten sie etwa die Mona Lisa zum Leben erwecken und sie sprechen lassen. Ebenso hat die Software Albert Einstein, Marilyn Monroe oder Salvador Dali das Reden beigebracht.

Trotz der technischen Meisterleistung mehrt sich die Kritik an den so genannten Deepfake-Videos. Es wird befürchtet, dass die Technik zu propagandistischen Zwecken eingesetzt wird und es irgendwann nicht mehr zu unterscheiden ist, ob ein Video echt oder gefälscht ist. Bekannt geworden sind Deepfake-Videos und die dazugehörige Software durch manipulierte Rache-Pornos.

Kommentare