YouTube will manipulierte Videos im US-Wahlkampf löschen

Dieser Artikel ist älter als ein Jahr!

Twitter und Microsoft haben angekündigt, gänzlich auf politische Werbung im US-Wahlkampf zu verzichten. Jetzt reagiert auch YouTube. Die Videoplattform hat angekündigt US-Wahlinhalte, die „ein großes Risiko für Schaden“ beinhalten würden, offline zu nehmen.

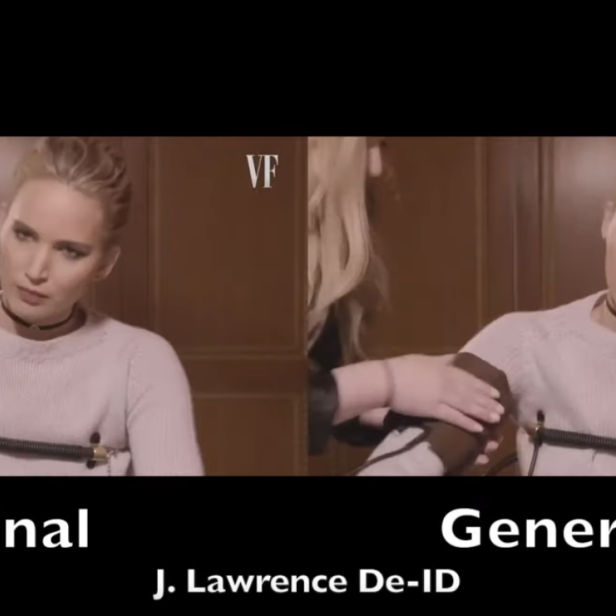

Gemeint sind damit etwa Videos, die ein falsches Datum der US-Wahlen beinhalten, oder die falsche Informationen über die Kandidaten verbreiten, etwa was ihre Staatsangehörigkeit betrifft. Auch Videos, die technisch manipuliert worden sind, sollen offline genommen werden. Das betrifft etwa sogenannte „Deep Fakes“. Auch Facebook hatte zuletzt angekündigt, gegen „Deep Fakes“ vorgehen zu wollen und diese offline nehmen zu wollen.

Manipulierte Videos

Grund für das Deep-Fake-Verbot auf Facebook ist das manipulierte Video, in dem US-Demokratin Nancy Pelosi im vergangenen Sommer zu sehen war und das viral ging. Der Inhalt wurde mithilfe einer Software so verändert, dass sich Pelosi betrunken und verwirrt anhörte.

„Über die letzten Jahre haben wir unsere Anstrengungen, YouTube zu einer verlässlichen Quelle für Nachrichten und Information zu machen, verstärkt“ sagt Leslie Miller, Managerin für politische Angelegenheiten bei YouTube. Diese Anstrengungen werde YouTube nun fortsetzen, und zwar „unabhängig von der politischen Meinung, die ein Video transportieren möchte.“

Bei YouTube werden pro Minute rund 500 Stunden an Material hochgeladen. Deshalb ist die Sichtung von Inhalten technisch eine große Herausforderung. Man werde künftig auch Channels blockieren, die ihre Herkunft oder die Zugehörigkeit zu Staaten bewusst verschleiern.

Microtargeting bei Facebook

Doch nicht nur Videos sorgen immer wieder für Desinformation im Netz. Im vergangenen US-Wahlkampf wurden politische Werbeeinschaltungen, die russischen Hintermännern zugeschrieben worden sind, auf Facebook geschaltet. Solche Botschaften können exakt an bestimmte Zielgruppen geschickt werden. Dabei ist keines der Bilder, Videos oder Texte, die Menschen auf Facebook zu sehen bekommen, Zufall.

Eines der Sujets, das aus Russland stammen soll, wurde von einer „Army of Jesus“ geschalten. Es wurde explizit nur Personen angezeigt, die auf Facebook angegeben haben, sich für „Christentum“, die „Bibel“ oder „Jesus“ zu interessieren. In der Werbung wurde verkündet, dass nun die Chance bestehe, einen „Präsidenten mit göttlichen moralischen Prinzipien“ zu wählen. Hillary Clinton war in dieser Anzeige als „Partnerin des Teufels“ bezeichnet worden. Derartige zielgerichtete Anzeigen nennt man „Microtargeting“, weil damit gewisse Botschaften an selektive Bevölkerungsgruppen ausgespielt werden.

Mehr Transparenz

Facebook war deshalb in massive Kritik geraten und hat Transparenzrichtlinien erlassen, aus denen hervorgehen soll, wer eine bestimmte Werbeanzeige schaltet. Damit soll klarer ersichtlich sein, wer hinter der Werbung steckt und welche weiteren Inhalte geschaltet wurden. Über eine Rubrik namens „View Ads“ sollen auf der Profilseite der Werbetreibenden alle Beiträge gesammelt angezeigt werden.

Mit diesen Kriterien sind auch im kommenden US-Wahlkampf 2020 wieder zielgerichtete, politische Werbeanzeigen auf Facebook möglich. Der ehemalige Facebook-Investor Roger McNamee spricht sich für ein härteres Vorgehen gegen das Online-Netzwerk aus. So sollen etwa Algorithmen stärker kontrolliert werden, die dafür sorgen, dass hasserfüllte Inhalte nach vorne gereiht werden. Das ist auch auf YouTube immer wieder ein Problem. Oft wurden Videos nach vorne gereiht und vielen Nutzern angezeigt, die starke Emotionen geweckt haben.

Kommentare