Google soll bei ChatGPT abgeschaut haben

Dieser Artikel ist älter als ein Jahr!

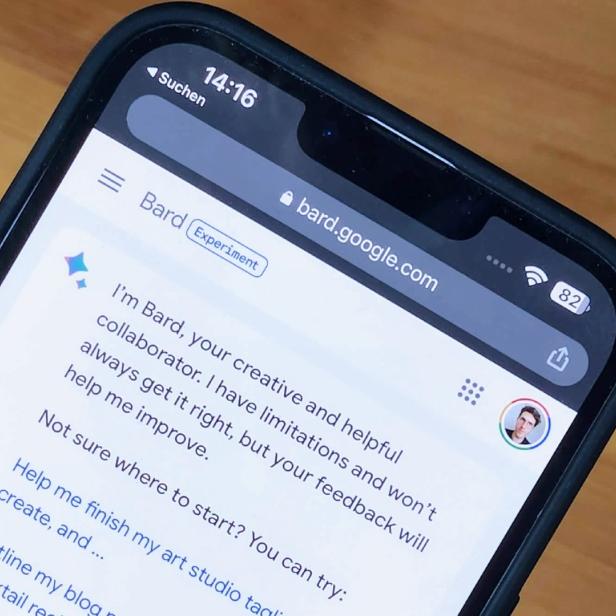

Google soll beim Training seines intelligenten Chatbots Bard geschummelt und Daten von ChatGPT verwendet haben. Ein führender KI-Forscher des Unternehmens soll daraufhin gekündigt haben. Google bestreitet den Vorfall.

Den Vorwürfen zufolge soll der Ingenieur Jacob Devlin den Chef des Google-Mutterkonzerns Alphabet, Sundar Pichai, darauf hingewiesen haben, dass "Daten von ChatGPT" für das Training des Chatbots verwendet wurden. Die Trainingsdaten würden von der Seite ShareGPT stammen, auf der Nutzer*innen ihre besten Konversationen mit der künstlichen Intelligenz teilen können.

KI-Forscher wechselte zur Konkurrenz

Devlin warnte davor, dass dies gegen die Geschäftsbedingungen der ChatGPT-Firma OpenAI verstoße und die Antworten der beiden Chatbots zu ähnlich werden könnten. Laut der Quelle des US-Blogs "The Information" kündigte Devlin daraufhin seinen Job bei Google und wechselte direkt zum Konkurrenten OpenAI.

Google bestreitet indes, Daten von ChatGPT für das Training von Bard verwendet zu haben. Es ist aber unklar, ob Google die GPT-Trainingsdaten bereits vor oder erst nach dem Vorfall aufgegeben hat. Gegenüber The Verge gab das Unternehmen lediglich an, dass Bard "nicht mit Daten von ChatGPT trainiert wurde". Die Frage, ob die Daten jemals zum Einsatz kamen, ließ die Firma unbeantwortet.

Bard gab verdächtige Antwort

Darüber hinaus berichtet das Portal "Android Authority", dass es kürzlich einen Screenshot einer Bard-Konversation von einer SEO-Agentur namens Loopex Digital erhalten habe. Darin wurde der Chatbot gefragt, auf welchem Sprachmodell er basiere. Bard antwortete, dass es auf GPT-3 basiere – demselben Modell wie ChatGPT.

Erst in einem späteren Gespräch antwortete Bard auf dieselbe Frage, dass es auf Googles Sprachmodell LaMDA basiere. Ob es sich bei diesem Fehler um einen Zufall handelt oder ob der Chatbot die Information von ChatGPT gelernt hat, ist unklar.

Kommentare