Apple Intelligence kommt nach Europa: Die KI-Funktionen im Test

iOS 18.4 ist da: Die KI-Tools von Apple Intelligence im Test

Dieser Artikel ist älter als ein Jahr!

Die KI-Funktionen von Apple Intelligence haben es endlich auch nach Europa und Österreich geschafft. Mit dem Update auf iOS 18.4 können die AI-Tools nun auch in deutscher Sprache verwendet werden.

Wer ein kompatibles iPhone und ausreichend Speicherplatz hat, wird auf dem Apple-Handy ab sofort der Künstlichen Intelligenz begegnen. Apple Intelligence benötigt zum Start mindestens 6,2 GB Speicherplatz.

Ich habe mir das zum Anlass genommen und Apple Intelligence unter die Lupe genommen - und zwar vorab. Mit einem US-Account, den entsprechenden Spracheinstellungen auf Englisch und der iOS 18.4 Beta-Version habe ich die KI-Funktionen ausprobiert. Kleinere Änderungen sind also möglich.

➤ Mehr lesen: iOS 19: Diese 5 Dinge kommen auf iPhone-Nutzer zu

Aufholjagd mit Hürden

Weil die Konkurrenz bei Künstlicher Intelligenz deutlich weiter war als Apple, versuchte der iPhone-Hersteller mit aller Gewalt in kürzester Zeit den Befreiungsschlag und kündigte Apple Intelligence mit Pauken und Trompeten an.

Wie sich allerdings herausgestellt hat, gibt es bei dieser Aufholjagd einige Hürden. Die AI-Features sind noch immer als Beta-Version gekennzeichnet und es sind längst noch nicht alle angekündigten Funktionen verfügbar.

➤ Mehr lesen: iPhone 16e im Test: Apple hat keine Konkurrenz

iPhone spielt Ambient-Musik

Zunächst aber noch schnell ein neues Feature, das mit iOS 18.4 auf die iPhones kommt und nichts mit Apple Intelligence zu tun hat. Daher ist es auch für alle iPhone-Nutzerinnen und -Nutzer verfügbar. Ab sofort ist ein Ambient-Musik-Player in das Kontrollzentrum integriert.

Dort gibt es künftig 4 neue Schaltflächen, mit denen man einen entsprechenden Radiosender starten kann: Sleep, Chill, Productivity und Wellbeing. Die einzelnen Tracks können weitergeschaltet werden und das Feature funktioniert auch dann, wenn man kein kostenpflichtiges Abo bei Apple Music hat - ziemlich praktisch und die Musikauswahl ist gar nicht schlecht.

© Florian Christof

KI weiß, was wichtig ist

Die KI-Funktion, die man als iPhone-Nutzer wohl als Erstes sehen wird, wird als "Priority Notifications" bezeichnet. Wenn Apple Intelligence glaubt, eine Nachricht sei besonders wichtig, dann wird sie entsprechend hervorgehoben und am Lockscreen an erster Stelle angezeigt.

Damit das tatsächlich so funktioniert, müssen die Priority Notifications in den Einstellungen unter Benachrichtigungen aktiviert werden.

Wie sich gezeigt hat, ist das eine sinnvolle und praktische Funktion. So werden etwa Anrufe hochgezogen und gehen nicht in der Benachrichtigungsflut unter. Manchmal greift die KI auch daneben und hebt weniger wichtige Nachrichten hervor oder stuft wichtige Notifications unwichtig ein.

Das führt uns gleich direkt zum Hauptproblem, das ich mit den AI-Features grundsätzlich habe. Man kann sich einfach nicht zu hundert Prozent darauf verlassen - egal ob bei Zusammenfassungen, Formulierungen, Fotobearbeitung oder einer KI-gestützten Suche. Die KI-Funktionen können aber dennoch hilfreich sein, man sollte mögliche Fehler aber stets im Hinterkopf behalten.

➤ Mehr lesen: iPhone-Design soll sich heuer "signifikant" ändern

Die Priority Notifications sind eigentlich recht praktisch.

© Florian Christof

Die KI fasst zusammen

Ein weiteres AI-Feature, dem man am Sperrbildschirm begegnen wird, sind KI-Zusammenfassungen von Benachrichtigungen - etwa bei Mails, WhatsApp-Nachrichten oder anderen Notifications. Auch diese Funktionen muss in den Einstellungen unter "Benachrichtigungen" aktiviert werden.

Bei der Mails-App funktioniert das einwandfrei. Meistens lässt sich ohnehin aus dem Betreff herauslesen, worum es in dem Mail geht. Die Zusammenfassung liefert aber darüber hinaus einen brauchbaren Überblick über den Inhalt.

Der kurze KI-Auszug wird übrigens auch im Posteingang in der Mail-App selbst dargestellt. Öffnet man eine Mail, kann man sich den Inhalt gleich noch einmal zusammenfassen lassen, wobei dieser erneute Überblick etwas ausführlich ist.

Nachdem man nun 3 Zusammenfassungen überflogen hat, kommt man aber trotzdem nicht darum herum, den Inhalt der Mail selbst zu lesen. Aber zumindest lässt sich anhand eines solchen Überblickes einschätzen, wie wichtig das Mail ist.

➤ Mehr lesen: Kameravergleich: Samsung Galaxy S25 Ultra vs iPhone 16 Pro

Bei den vielen Zusammenfassungen könnte man den eigentlichen Mail-Inhalt fast übersehen.

© Florian Christof

Bei WhatsApp besonders praktisch

Besonders praktisch sind die AI-Kurzfassungen bei WhatsApp-Nachrichten. Hier fasst Apple Intelligence gleich mehreren Messages in einem Überblick zusammen. Erhält man etwa 4 Nachrichten, wird am Lockscreen eine einzige AI-Summary von dem gesamten Sachverhalt dargestellt.

➤ Mehr lesen: Wofür das "e" im neuen iPhone 16e steht

Bei WhatsApp-Nachrichten können die KI-Zusammenfassungen ihre volle Stärke ausspielen.

© Florian Christof

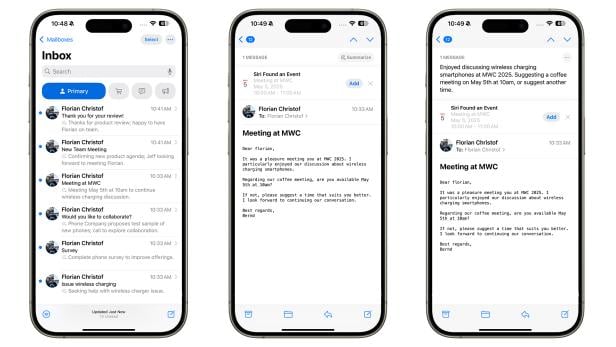

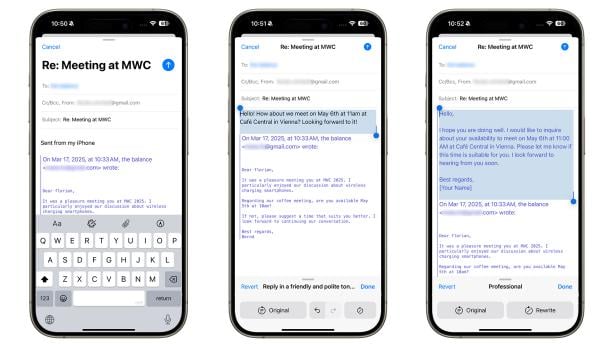

Smarte Schreibwerkzeuge

Auf die intelligenten Schreibwerkzeuge kann man direkt über die Tastatur zugreifen - dort wo sich auch das Wörterbuch befindet. Verfügbar sind die sogenannten Writing-Tools allerdings nur in den Apple-eigenen Apps. In Drittanbieter-Apps - etwa WhatsApp oder Gmail - gibt es dieses Feature nicht.

Formulierungen von Texten und das Treffen des passenden Tons funktioniert einwandfrei. Schwierigkeiten hat die Apple-KI wenn es darum geht, komplexere Aufgaben zu erledigen - etwa den Maps-Link zu einer Location zu generieren oder ein Kalender-Event-File zu erstellen.

Beim Antworten auf eine Mail habe ich beispielsweise das Café Central in Wien als Ort für ein Meeting vorgeschlagen und die AI darum gebeten, den Maps-Link zum Lokal einzufügen. Das hat die KI in diesem Fall gänzlich verweigert.

Allzu komplex sollten die Aufgaben für die Writing-Tools nicht sein.

© Florian Christof

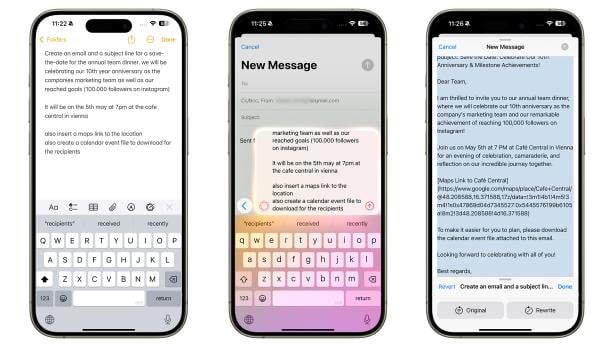

Kein Kalender-File, unvollständiger Link

Als ich einen ähnlichen Prompt beim Erstellen einer neuen Mail eingegeben habe, wurde ein solcher Link erzeugt. Allerdings wurde nur eine ewig lange URL angezeigt, die aber nicht klickbar war. Warum Apple dabei auf Google Maps zurückgreift, ist auch ein bisschen schleierhaft.

Im selben Prompt habe ich nach einem Kalender-File gebeten, damit man das Meeting gleich direkt in seinen Kalender bekommt. Im generierten Text wurde zwar darauf verwiesen, dass ein solches File im Anhang ist, dem war aber nicht so. Es war der Apple-AI nicht möglich, eine solche Datei zu generieren.

Leider ist das Generieren von Links etwas umständlich und nicht wirklich zielführend.

© Florian Christof

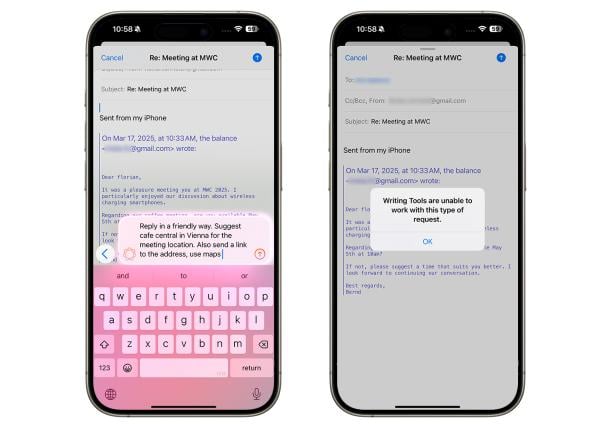

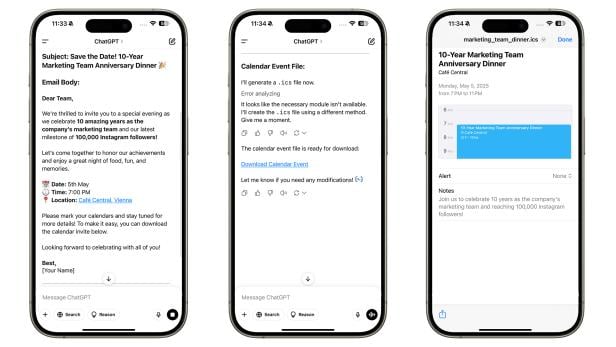

Anders sah es in der ChatGPT-App am iPhone aus. Mit demselben Prompt wurde die Ortsangabe "Café Central", gleich mit einem passenden Link hinterlegt. In einem weiteren Schritt wurde auch ein entsprechendes .ics-File erstellt. Außerdem finde ich die Formatierung deutlich schöner und übersichtlicher.

Dann habe ich denselben Prompt noch bei der Gemini-App von Google am iPhone eingegeben. Es konnte der Maps-Link zum Café Central erstellt werden, beim Kalender-File musste Gemini aber auch passen. Die Formatierung ist auch hier besser.

Bei ChatGPT klappt sowohl das Erstellen von Links als auch das Generieren von Kalender-Files.

© Florian Christof

Natürlich ist es praktisch, wenn direkt in der Mail-App der Text für eine E-Mail erstellt wird. So einwandfrei funktioniert dies aber leider nicht. Und wie sich gezeigt hat, lässt sich mehr rausholen, wenn man ChatGPT oder Gemini verwendet. Da lohnt sich das umständlichere Copy-&-Paste.

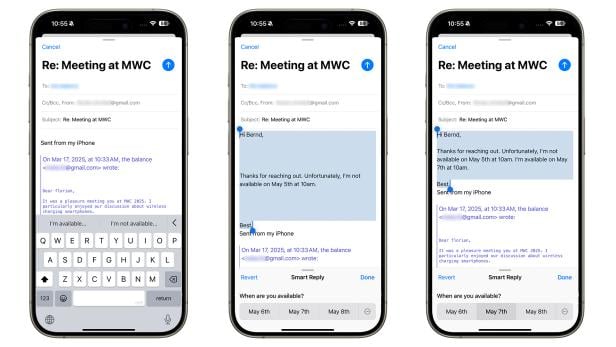

Außerdem ist mir ein Fehler aufgefallen, der das intelligente Writing-Tool in der Mail-App fast unbrauchbar macht. Antwortet man nämlich damit auf eine Mail, wird der Text als Teil der ursprünglichen Mail dargestellt und nicht als Antwort-Text.

Nutzt man für eine Antwort das Smart-Reply-Feature, wird die Mail korrekt formatiert. Diese Funktion ist möglicherweise sogar praktischer, weil sie gezielt nach Informationen fragt und diese in die Antwort-Mail einfließen lässt.

Beim Antworten auf eine Mail wird der Text völlig falsch formatiert.

© Florian Christof

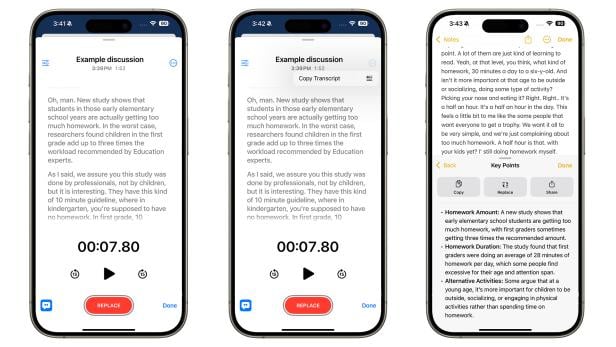

Transkript von Sprachaufzeichnungen

Ein weiterer Klassiker unter den KI-Funktionen, die sich mittlerweile auf fast allen besseren Handys befinden, ist das Transkribieren von Sprachaufzeichnungen. Auch Apple Intelligence bietet ein solches Feature in der Recorder-App. Aber auch hier hat Apple gegenüber der Konkurrenz das Nachsehen.

Die Spracherkennung auf Englisch ist makellos - daran gibt es absolut nichts auszusetzen. Man kann die aufgezeichneten Recordings aber nur im Nachhinein transkribieren lassen. Eine Live-Übersetzung wie sie etwa das Xiaomi 15 ermöglicht, gibt es nicht.

Außerdem kann Apple Intelligence nicht erkennen, wenn unterschiedliche Personen sprechen. Die Galaxy AI von Samsung kann beispielsweise bei einer Diskussion die Wortspenden verschiedenen Personen zuweisen.

Wenn das Transkript dann vorliegt, ist es in der Recorder-App nicht möglich, eine Zusammenfassung zu erhalten. Es gibt lediglich eine "Copy"-Taste. Erst wenn man sich den Text etwa in die Notes-App kopiert hat, kann man sich eine KI-Kurzfassung erstellen lassen.

Das Transkribieren funktioniert einwandfrei. Mehr Funktionen in der Recorder-App wären wünschenswert.

© Florian Christof

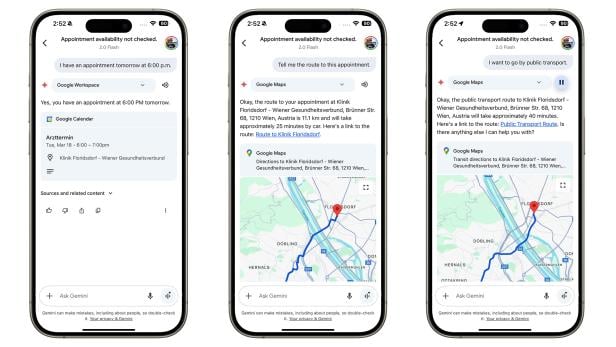

Siri wird zum Problem für Apple

Als zentrale Schaltstelle für Apple Intelligence sollte eigentlich Siri dienen. Apple hatte ein grundlegend neu gestaltetes Sprachassistenzsystem versprochen, das spätestens im Frühjahr verfügbar sein sollte.

Daraus wird offenbar aber nichts. Den entsprechenden Werbespot hat Apple bereits zurückgezogen und von seinem YouTube-Kanal entfernt. Angeblich steckt die Entwicklung einer künstlich-intelligenten Siri in der Sackgasse, sodass damit erst gegen 2027 gerechnet wird.

Die neue Animation beim Aufrufen von Siri lässt zwar vermuten, dass in der Sprachassistentin nun einiges an KI steckt. Allzu intelligent ist Siri aber leider nicht. Mehr als deutlich wird dies, wenn man Siri mit Google-Gemini vergleicht.

➤ Mehr lesen: Apple muss bei KI-Features für Siri von vorn anfangen

Siri hat grobe Probleme.

© Florian Christof

Siri vs. Gemini

Siri kann zwar problemlos einen Kalendereintrag hervorholen. Wenn ich mir aber die Route zu dem Arzttermin anzeigen lassen möchte, klappt das entweder überhaupt nicht oder Siri möchte mich nach Neuseeland schicken. Im Kalendereintrag ist als Ort übrigens die Klinik Floridsdorf samt Adresse hinterlegt.

Wenn ich Google Gemini auf einem iPhone vor dieselbe Aufgabe stelle, wird nicht nur der entsprechende Kalendereintrag angezeigt. In einem weiteren Schritt liefert Gemini auch die passende Route für die Anreise per Auto. Teilt man Gemini daraufhin mit, dass man lieber die öffentlichen Verkehrsmittel nutzt, zeigt der KI-Assistent die Öffi-Route samt Link zu Google Maps.

Bei Siri hat Apple also wirklich enormen Aufholbedarf. Dass selbst auf einem iPhone die Google-App besser funktioniert, dürfte Apple ganz und gar nicht schmecken.

➤ Mehr lesen: Apples neue Siri könnte erst 2027 kommen

Gemini hat mit derselben Aufgabe kein Problem.

© Florian Christof

Visual Intelligence

Mit iOS 18.4 wird eine KI-Funktion für die 15er-Pro-Modelle verfügbar, die bislang den iPhone-16-Modellen vorbehalten war. Mit Visual Intelligence ist es möglich, die Kamera als Suche zu verwenden, ohne dass man ein Foto aufnehmen muss.

Das Feature lässt sich entweder über das Kontrollzentrum aufrufen, mittels Action-Button aktivieren oder per Kamerataste starten. Anschließend hat man die Wahl zwischen "Ask" und "Search". Bei der bloßen Suche handelt es sich um eine herkömmliche Google-Image-Suche.

Bei "Ask" greift das iPhone auf ChatGPT zurück. Gibt man keine Frage ein und drückt nur das vorliegende Icon, beschreibt die KI, was im Bild zu sehen ist. Gibt man zusätzliche eine Frage ein, versucht ChatGPT diese im Kontext des Bildes zu beantworten. Ein praktisches Feature, das ich bestimmt im Auge behalten werde.

➤ Mehr lesen: Dummy von iPhone 17 Air zeigt, wie dünn es sein soll

Visual Intelligence kann über den Action Button gestartet werden.

© Florian Christof

Mithilfe von ChatGPT liefert Visual Intelligence teils brauchbare Ergebnisse.

© Florian Christof

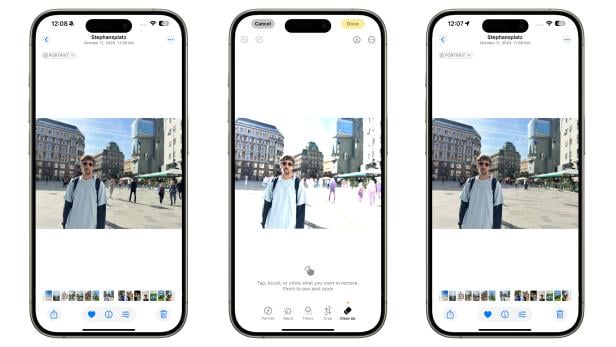

KI-Radierer

Apple Intelligence bringt endlich auch KI-Radierer in der Foto-App, der längst überfällig ist. Das sogenannte "Clean Up"-Tool ist übrigens das einzige AI-Werkzeug in der Foto-App - KI-Verschönerungen oder ähnliches gibt es nicht.

Clean-Up funktioniert dafür so gut, dass es tatsächlich ein hilfreiches Tool darstellt. Wie vergleichbare Funktionen der Konkurrenz hat auch Clean-Up seine Schwierigkeiten, wenn es um komplexe Aufgaben geht. Das bloße Löschen von Objekten oder Menschen auf einfachen Hintergründen geht aber problemlos über die Bühne.

Schade ist allerdings, dass man die zu löschenden Stellen nur grob markieren kann und das iPhone dann alles Weitere selbständig ausführt. Es wäre wünschenswert, wenn es einen oder mehrere Zwischenschritte gäbe, wo man die Einstellungen noch verfeinern kann.

➤ Mehr lesen: KI-Radierer von Apple, Google und Samsung im Vergleichstest

Mit nicht allzu komplexen Aufgaben kann das Clean-up-Tool recht gut umgehen.

© Florian Christof

Neue Suche in der Fotos-App

Praktisch ist auch die neue Suche in der Fotos-App, die kontextbasiert funktioniert. Mit dem Prompt "every food in june in munich" werden alle Fotos angezeigt, die eben Essen in München im Monat Juni zeigen.

Allzu versiert ist die Suche allerdings nicht. Die Anfrage "everything I ate in Munich in June", liefert keine Ergebnisse. Die Ortsangabe "London" funktioniert, "Great Britain" als Parameter verweigert die Suche aber.

Bei komplexen Aufgaben sollte man nicht hinenzoomen. Aus der Ferne betrachtet, schaut es aber recht gut aus.

© Florian Christof

Bilder und Emojis generieren

Mit Apple Intelligence kommen auch jede Menge KI-Spielereien auf die iPhones - etwa das Erstellen von Bildern oder Emojis. Die sogenannten Genmojis sind nur in der Messages-App von Apple verfügbar. Dabei können individuelle Emojis erstellt und versendet werden.

Für das Generieren von Bildern hat Apple eine eigene Anwendung parat. In der Playground-App kann man aus vordefinierten Szenerien wählen, etwa Party, Birthday, Firework oder ähnlichem. Diese Basis lässt sich dann mit weiteren Beschreibungen verfeinern und anreichern.

Es ist auch möglich, völlig eigene Wünsche darstellen zu lassen. Auch Personen können im KI-Stil generiert werden. Als grundlegenden Stil kann man darüber hinaus aus Animation, Skizze und Illustration wählen.

➤ Mehr lesen: Amazon stellt völlig neue Alexa Plus mit KI vor

Das Generieren von Emojis, Sticker und Bilder ist eine nette Spielerei.

© Florian Christof

Bilder aus Notizen und Skizzen erstellen

Die Notes-App hat dieselbe Bilder-KI integriert, mit der man direkt aus den Notizen ein Bild generieren kann. Man kann ein Wort oder eine ganze Textpassage markieren und im Popup-Menü - dort wo man die Formatierungen findet - "Create Image" auswählen, um ein entsprechendes Bild zu erhalten.

Gleichzeitig ist es in der Notes-App auch möglich, Bilder anhand von Skizzen zu erstellen. Mithilfe des "Magic Wand"-Tools kreist man die jeweilige Skizze ein, verfeinert diese Basis mit weiteren Text-Prompts und Apple Intelligence versucht daraus ein passendes Bild zu generieren.

➤ Mehr lesen: Gruselig menschliche KI im Test: Ich habe mit Miles telefoniert

Ob das Generieren von Bildern per Texteingabe nicht schneller geht?

© Florian Christof

Fazit

Es ist mehr als deutlich, dass Apple seine KI-Funktionen überhastet auf die iPhones gebracht hat. Auch wenn überall der Hinweis steht, dass es sich um eine Beta-Version handelt, ändert es nichts daran, dass die AI-Features groß beworben wurden, zum Teil aber etliche Schwächen aufweisen.

Das ist eigentlich gar nicht der Stil, den man von Apple gewohnt ist. Normalerweise liefert der iPhone-Hersteller zuerst ein wunderbar funktionierendes Produkt und erklärt erst dann, was es kann.

Bei Apple Intelligence ist es genau umgekehrt. Ohne ein fertiges Produkt zu haben, hat Apple vollmundig angekündigt, was die KI-Funktionen nicht alles leisten können. Nun kommt es zur Ernüchterung, weil die AI-Features nicht so recht halten, was versprochen wurde.

Fairerweise muss man sagen, dass auch die KI-Funktionen der Konkurrenz nicht wesentlich besser sind. Egal ob Samsung, Google oder Xiaomi, die Künstliche Intelligenz kann zwar bei manchen Sachen hilfreich sein, beim Halten der diesbezüglichen Versprechen hakt es aber bei allen Herstellern.

Positiv und negativ aufgefallen

Positiv aufgefallen sind mir die Zusammenfassungen bei den Notifications am Lockscreen, sowie die Priority Notifications. Das ist wirklich sehr praktisch und eine Erleichterung. Einen weniger guten Eindruck haben die intelligenten Schreibwerkzeuge beim Erstellen komplexer Texte hinterlassen. Hier liefern ChatGPT und Google Gemini die umfangreicheren Funktionen.

Ähnlich sieht es auch bei Siri aus. Während Gemini per Sprachbedienung zielgerichtete Infos anzeigt, ist Siri zum Teil komplett auf verlorenem Posten. Da hat Apple tatsächlich einiges an Boden gut zu machen.

Die KI-Spielereien, wie Bilder erstellen oder Emojis generieren, funktionieren recht gut. Nach dem einmaligen Ausprobieren habe ich allerdings nicht mehr darauf zurückgegriffen.

Der KI-Radierer in der Fotos-App liefert einigermaßen brauchbare Ergebnisse. Ebenso ist auch die verbesserte Suche in der Fotos-App eine willkommene Neuerung. Vergleicht man allerdings die beiden Funktionen mit der Fotos-App von Google, dann hat Apple das Nachsehen.

Die Frage ist, ob es nicht oft umständlicher ist, auf die KI-Funktionen zurückzugreifen.

© Florian Christof

Ist die KI tatsächlich hilfreich?

Am Ende bleibt bei derartigen KI-Funktionen immer die Frage, ob sie tatsächlich eine Erleichterung darstellen. Auch wenn ich mehrere Kurzfassungen von Mails und Nachrichten erhalte, komme ich nicht darum herum, die gesamte Mail zu lesen. Macht die KI also vielleicht sogar mehr Arbeit?

Bei den intelligenten Schreibwerkzeugen - egal ob bei Apple Intelligence, Gemini oder ChatGPT - ist es notwendig, einen detaillierten und ausführlichen Prompt einzugeben, damit ein passender Text generiert werden kann, der ohnehin noch angepasst werden muss. Da bin ich so manches Mal schneller, wenn ich einfach gleich den Text selbst schreibe. Verkompliziert die KI eventuell die einfachsten Tätigkeiten?

Überaus hilfreich sind die Writing-Tools aber auf alle Fälle, wenn es darum geht, neue Formulierungen zu finden oder kreative Verfeinerungen vorzuschlagen. Auch bei Zusammenfassung längerer Texte können die KI-Funktionen hilfreich sein. Richtig mächtig sind die AI-Features vor allem dann, wenn man in einer Fremdsprache nicht ganz fix ist.

Das, was es ist

Damit Apple Intelligence nicht enttäuschend aufgenommen wird, sollte man es als das sehen, was es tatsächlich ist: Work in Progress. KI-Funktionen werden natürlich ständig weiterentwickelt und lernen durch ihre Verwendung kontinuierlich dazu. Und so werden auch die AI-Features auf den iPhones mit der Zeit immer besser werden.

Das mit der Verwendung ist aber in bisschen so eine Sache. Denn allzu viele iPhone-User werden Apple Intelligence vorerst wohl nicht begegnen. Die KI-Funktionen sind nämlich nur für die aktuellen iPhone-16-Modelle inklusive iPhone 16e verfügbar. Bei der 15er-Reihe kann Apple Intelligence nur auf den Pro-Modellen genutzt werden.

Abseits der iPhones gibt es Apple Intelligence auch auf iPads und MacBooks. Alle Apple-Geräte, die mindestens von einem A17 Pro oder einem M1-Prozessor angetrieben werden, unterstützen die KI-Funktionen.

Kommentare